Dans le monde actuel axé sur les données, l’IA n’est pas seulement sur la carte – elle est sur la voie rapide. Qu’il s’agisse d’extraire des informations essentielles, de suivre les évolutions réglementaires, de prévoir les risques, de surveiller les indicateurs de santé et de sécurité des employés ou de rationaliser les rapports, l’IA est en train d’orienter l’avenir de l’ESS, du développement durable et de la conformité. Mais alors que les professionnels prennent le volant, quels sont les obstacles et les feux verts qui se dressent sur le chemin ? Cette série d’articles vous aidera à naviguer dans l’avenir de l’IA en matière d’ESS.

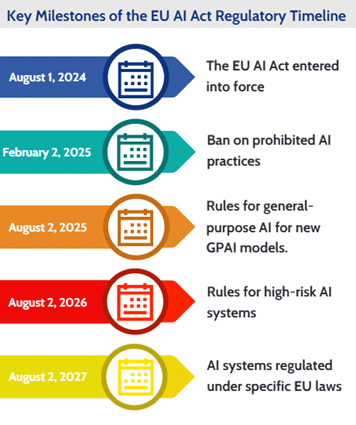

L’Europe a toujours été à la pointe des affaires réglementaires. Il n’est donc pas surprenant qu’en 2021, le Parlement européen ait qualifié de première mondiale la préparation de l’actuel règlement (UE) 2024/1689 sur l’intelligence artificielle(EU AI ACT). Aujourd’hui, le Comité européen de normalisation élabore des cadres pour encadrer l’intelligence artificielle. Pourtant, même dans une Europe avisée en matière de réglementation, les législateurs s’efforcent encore de rattraper leur retard, car l’IA a fait irruption dans nos vies rapidement et évolue à une vitesse fulgurante.

En conséquence, les régulateurs doivent gérer de nombreuses variables à la fois et faire face à des changements rapides. Ils sont contraints de se concentrer sur des domaines spécifiques, tels que les problèmes de sécurité.

L’IA soulève en effet de nombreuses questions : problèmes de droits d’auteur, questions de responsabilités et autres, mais l’Europe a fait preuve d’audace. Dans le cadre de la stratégie numérique de l’UE, la Commission européenne a proposé la première loi européenne sur l’intelligence artificielle en avril 2021, une classification de l’IA basée sur les risques. Les systèmes d’intelligence artificielle pouvant être utilisés dans différentes applications doivent être analysés et classés en fonction du risque qu’ils représentent pour les utilisateurs. Les quatre niveaux de risque sont associés à des exigences de conformité en matière d’intelligence artificielle qui doivent être strictement mises en œuvre. Dans l’intervalle, les systèmes doivent également rester sous surveillance humaine plutôt que sous contrôle automatisé afin d’éviter des résultats involontaires ou néfastes.

À première vue, ce n’est pas grand-chose. Soyons honnêtes : nous avons désespérément besoin d’une intelligence artificielle sûre et bien réglementée, qui peut nous apporter de nombreux avantages, tels que de meilleurs soins de santé et environnements de travail, une fabrication plus efficace et une énergie plus durable. D’un autre côté, il y a de plus en plus de fraudes malveillantes liées à l’intelligence artificielle et de fausses vidéos, qui font malheureusement aussi partie de l’histoire. Les régulateurs n’ont pas d’autre choix que de suivre le rythme des tendances de l’intelligence artificielle en plein essor.

La loi européenne sur l’IA établit des règles différenciées en fonction des niveaux de risque

Le résultat de plusieurs années de débat a introduit un cadre à plusieurs niveaux qui impose des obligations aux fournisseurs en fonction du niveau de risque qu’ils font peser sur les utilisateurs de leurs systèmes d’IA. Bien que la plupart des applications d’IA soient considérées comme présentant un faible risque, toutes seront soumises à une évaluation.

Pratiques interdites

Selon les nouvelles règles, les applications considérées comme présentant un “risque inacceptable” sont interdites dans l’UE. Il s’agit notamment de la manipulation du comportement cognitif, comme les jouets pour enfants à commande vocale qui encouragent les actions dangereuses, des systèmes de notation sociale qui classent les gens en fonction de leur comportement ou de leur statut socio-économique, et de l’identification et de la catégorisation biométriques, y compris la reconnaissance faciale en temps réel dans les espaces publics.

Des dérogations limitées sont probables pour les forces de l’ordre. La surveillance biométrique en temps réel pourrait être autorisée dans des cas graves étroitement définis, tandis que l’identification biométrique différée pourrait être utilisée dans le cadre de poursuites judiciaires pour des crimes graves, sous réserve de l’approbation préalable d’un tribunal.

Systèmes à haut risque

L’IA considérée comme portant atteinte à la sécurité ou aux droits fondamentaux entre dans la catégorie “risque élevé”, avec les deux groupes principaux suivants :

- Les systèmes intégrés dans des produits déjà couverts par la législation européenne sur la sécurité des produits, tels que les jouets, les voitures, l’aviation, les ascenseurs, les dispositifs médicaux, etc.

- Les systèmes autonomes dans les secteurs sensibles, notamment les infrastructures critiques, l’éducation, l’emploi, l’accès aux services essentiels, l’application de la loi, les migrations et le contrôle des frontières, ainsi que la prise de décisions juridiques.

Tous les systèmes à haut risque doivent être enregistrés dans une base de données de l’UE, faire l’objet d’une évaluation avant leur mise sur le marché et rester soumis à un contrôle tout au long de leur cycle de vie. Les utilisateurs pourront déposer des plaintes auprès des autorités nationales.

Risque limité/faible : Transparence et modèles à usage général

Les systèmes d’IA générant ou manipulant des images, du contenu audio ou vidéo, ainsi que les chatbots, sont autorisés avec des exigences de transparence minimales, ce qui signifie essentiellement qu’ils doivent avertir les utilisateurs qu’ils interagissent avec l’IA. Cela leur permettrait de décider s’ils veulent continuer à utiliser les systèmes ou non.

Ces exigences de transparence sont les suivantes :

- Indiquer clairement que le contenu est généré par l’IA.

- Concevoir le modèle pour éviter qu’il ne génère des contenus illégaux.

- Publier des résumés des données protégées par le droit d’auteur utilisées pour la formation.

Les outils d’IA, tels que ChatGPT, sont autorisés sans obligation, mais la loi européenne sur l’IA et l’Office de l’IA de l’UE invitent les fournisseurs à créer et à mettre en œuvre des codes de pratique volontaires.

L’UE cherche à stimuler l’innovation et à soutenir les jeunes pousses de l’IA

La loi européenne sur l’IA ne vise pas seulement à limiter les risques, mais aussi à stimuler l’innovation et à renforcer la position de l’Europe dans le domaine de l’intelligence artificielle. La législation permet aux entreprises de développer et de tester des modèles d’IA à usage général avant leur diffusion publique, dans le but de donner aux startups et aux petites entreprises une marge de manœuvre pour se développer.

Les autorités nationales seront tenues de fournir des “bacs à sable réglementaires”, des environnements d’essai qui reproduisent les conditions du monde réel. Selon les législateurs, ces environnements aideront les petites et moyennes entreprises à être plus compétitives sur le marché européen de l’IA, qui est en pleine expansion.

Contrôle de l’application et de la mise en œuvre

Outre les exigences du règlement, les opérateurs doivent prendre toutes les mesures nécessaires pour s’assurer que les lignes directrices publiées par la Commission européenne sont correctement et efficacement mises en œuvre. Pour éviter toute violation de ces mesures, les États membres doivent adopter des règles relatives aux sanctions et autres outils d’application, qui peuvent également inclure des avertissements et des mesures non pécuniaires. Les pratiques interdites en matière d’intelligence artificielle sont passibles d’une amende pouvant atteindre 40 millions d’euros ou 7 % du chiffre d’affaires annuel global de l’entreprise.

L’Office de l’IA nouvellement créé par la Commission européenne est chargé de clarifier les dispositions de la loi et de guider les régulateurs nationaux.

L’organisme européen de normalisation se prépare à soutenir la loi sur l’IA

La volonté de l’Europe de réglementer l’intelligence artificielle s’accompagne d’un vaste effort de normalisation. Le Comité technique conjoint 21(JTC 21) du Comité européen de normalisation(CEN) et du Comité européen de normalisation électrotechnique (CENELEC), lancé en juin 2021, rassemble plus de 300 experts de plus de 20 pays pour rédiger des normes harmonisées en matière d’intelligence artificielle qui sous-tendront la loi sur l’intelligence artificielle de l’UE.

Mandat et rôle – Le comité JTC 21 a pour mission d’élaborer des normes qui reflètent les besoins du marché et de la société européenne, s’alignent sur les objectifs politiques de l’UE et fournissent des outils pratiques pour le respect de la loi sur l’IA. Il assure également la coordination avec d’autres comités techniques et intègre les normes internationales le cas échéant.

Soutenir la loi sur l’IA – La Commission européenne a officiellement chargé le JTC 21 d’élaborer des normes harmonisées qui, une fois publiées au Journal officiel de l’UE, donneront aux entreprises une “présomption de conformité” à la loi. Ces normes serviront de guide de conformité, couvrant la gestion des risques, la transparence, la surveillance humaine, la cybersécurité et l’assurance qualité dans les domaines suivants :

- Cadre de fiabilité de l’IA

- Gestion des risques liés à l’IA pour faire face aux risques opérationnels

- Systèmes de gestion de la qualité de l’IA pour les processus de développement

- Évaluation de la conformité de l’IA pour vérifier la conformité

D’autres travaux portent sur les ensembles de données, les biais, la vision par ordinateur, la cybersécurité, la robustesse, la journalisation et le traitement du langage naturel – des domaines considérés comme essentiels pour la mise en œuvre du régime européen fondé sur le risque.

Le programme de travail complet du comité est disponible sur la plateforme eNorm de l’UE.

Ressources associées

News

News

News

News